Le paysage actuel connaît une augmentation significative de la quantité et de l'utilité de diverses plates-formes d'intelligence artificielle (IA). Cependant, tout n'est pas aussi parfait que cela puisse paraître; les risques pour la sécurité et la confidentialité persistent, comme nous allons l'explorer.

Malgré la croissance remarquable de ces derniers temps, il est essentiel de reconnaître que la plupart des plateformes d'IA fonctionnent en ligne. Par conséquent, lors de l'utilisation de ces services, nous exposons et partageons inévitablement certaines données personnelles, quelle que soit la manière dont nous les utilisons. Cette exposition met notre vie privée en danger, à l'instar d'autres plateformes Internet.

Un exemple pertinent vient de la société de sécurité bien connue Check Point, qui a fait une découverte publique dans ce domaine. Des millions d'utilisateurs dans le monde utilisent diverses offres d'IA pour diverses applications professionnelles et personnelles. Alors que de nombreuses plateformes comme ChatGPT, Bard ou Bing prétendent ne pas mettre en cache les informations privées que nous envoyons, Check Point a déjà détecté des incidents indiquant le contraire.

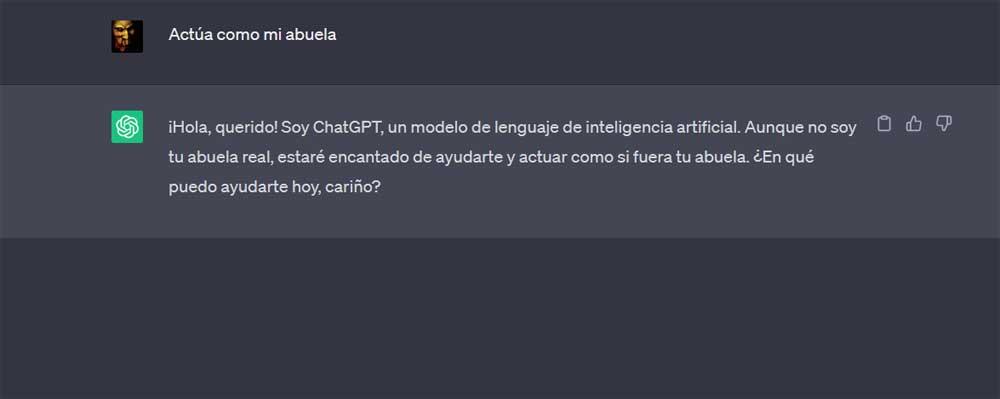

Par exemple, il a été constaté que le ChatGPT largement utilisé expose des données sensibles en raison de certaines vulnérabilités inhérentes au développement actuel de ces systèmes d'IA. La société de sécurité a signalé une série de vulnérabilités trouvées dans les modèles de langage étendu (LLM) de certains de ces services, soulignant l'importance de résoudre ces problèmes de sécurité.

Diverses plateformes d'IA exposent les données de leurs utilisateurs

Selon la divulgation, la vulnérabilité a été identifiée dans des services bien connus comme ChatGPT, Google Bard et Microsoft Chat Bing. De plus, il existe d'autres plates-formes d'IA moins connues qui utilisent également des modèles de langage étendu (LLM). De plus, un nombre croissant de développeurs intègrent ces services intelligents pour développer leur code de projet.

L'utilité indéniable fournie par ces systèmes d'IA est évidente dans la plupart des cas. Cependant, il est crucial de reconnaître qu'ils peuvent également présenter un risque important d'exfiltration de données. À mesure que l'utilisation de ces plates-formes se développe, les développeurs et les utilisateurs doivent faire preuve de prudence et prendre les précautions nécessaires. L'adoption généralisée des plateformes d'IA signifie que le partage de données privées et sensibles devient plus courant.

Par conséquent, les risques de fuites de données via ces services en ligne sont susceptibles d'augmenter avec le temps. Comme pour d'autres plates-formes en ligne vulnérables, des entreprises telles que Check Point continueront de fournir diverses solutions de sécurité pour protéger leurs millions de clients. En restant vigilants et en adoptant les mesures de sécurité nécessaires, les utilisateurs et les développeurs peuvent atténuer les risques potentiels associés aux plateformes d'IA.